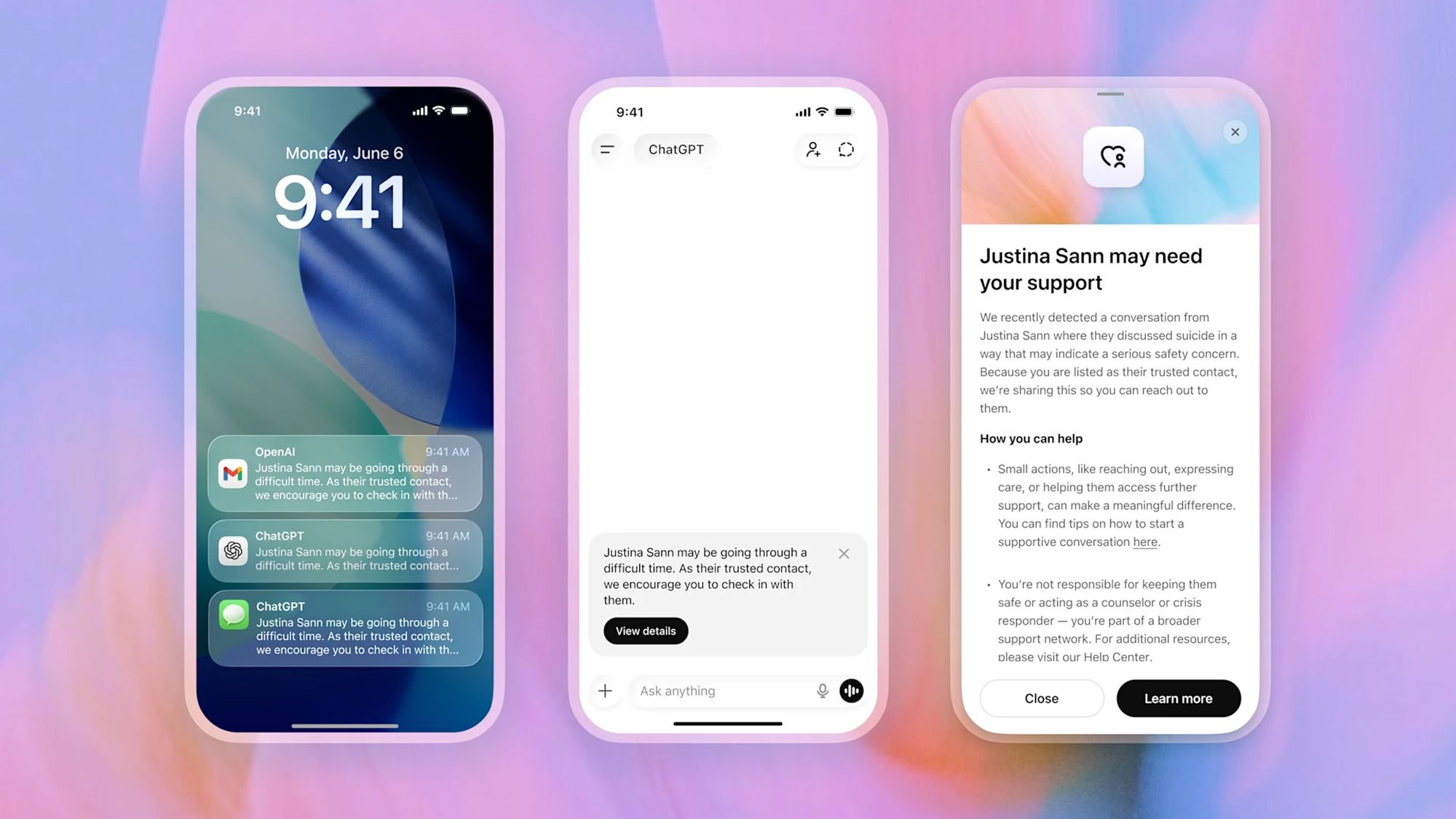

أطلقت OpenAI هذا الأسبوع ميزة أمان اختيارية تسمى Trusted Contact، والتي تسمح لمستخدمي ChatGPT البالغين بتعيين صديق أو أحد أفراد العائلة لتلقي إشعارات في حالة ظهور مناقشات حول إيذاء النفس أو الانتحار في برنامج الدردشة الآلية. أعلنت الشركة.

تقول OpenAI أنه إذا اكتشف نظام المراقبة الآلي الخاص بـ ChatGPT أن المستخدم “ربما ناقش إيذاء النفس بطريقة تشير إلى وجود خطر أمني خطير”، فسيقوم فريق صغير بمراجعة الموقف وإخطار جهة الاتصال إذا كان التدخل مطلوبًا. ستتلقى جهة الاتصال الأمنية المعينة دعوة مسبقًا لشرح دورها وقد ترفض ذلك.

(الإفصاح: رفعت Ziff Davis، الشركة الأم لـ CNET، دعوى قضائية ضد OpenAI في عام 2025، زاعمة أنها انتهكت حقوق الطبع والنشر الخاصة بـ Ziff Davis في تدريب وتشغيل أنظمة الذكاء الاصطناعي.)

ويأتي هذا الإعلان بعد أن تم ربط روبوتات الدردشة المدعمة بالذكاء الاصطناعي بالعديد من حالات إيذاء النفس والوفيات، مما أدى إلى العديد من الدعاوى القضائية التي تتهم المطورين بالفشل في منع مثل هذه النتائج. وفي إحدى الحالات البارزة في كاليفورنيا، صرح والدا صبي يبلغ من العمر 16 عامًا قام ChatGPT بدور “المدرب الانتحاري” لابنهما.زاعمًا أن المراهق ناقش طرق الانتحار باستخدام نموذج الذكاء الاصطناعي عدة مرات وأن برنامج الدردشة الآلي عرض عليه مساعدته في كتابة رسالة انتحار.

وفي حالة منفصلة، عائلة أحد خريجي جامعة تكساس إيه آند إم الجدد رفع دعوى قضائية ضد OpenAIيزعمون أن روبوت الدردشة الاصطناعي الذي يعمل بالذكاء الاصطناعي شجع ابنهم على الانتحار بعد أن طور علاقة عميقة ومزعجة معه.

ونظرًا لأن النماذج اللغوية الكبيرة تحاكي الكلام البشري من خلال التعرف على الأنماط، فإن العديد من المستخدمين يصبحون مرتبطين بها عاطفيًا، ويعاملونهم كمقربين وحتى كشركاء رومانسيين. تم تصميم LLMs أيضًا لمتابعة القيادة البشرية والحفاظ على المشاركة، مما قد يؤدي إلى تفاقم مخاطر الصحة العقلية، خاصة بالنسبة للمستخدمين المعرضين للخطر.

ذكرت OpenAI في أكتوبر الماضي أن أبحاثها أظهرت أن أكثر من مليون مستهلك لـ ChatGPT أسبوعيًا إرسال رسائل تحتوي على “علامات واضحة على التخطيط أو النية الانتحارية المحتملة”. دراسات عديدة لقد وجدت أن برامج الدردشة الشائعة مثل ChatGPT, كلوديوس و التوائم فقد يقدمون نصائح ضارة أو لا يقدمون أي نصائح مفيدة على الإطلاق للأشخاص الذين يعانون من الأزمات.

تظهر ميزة الاتصال المخصصة الجديدة بعد تنفيذ OpenAI الرقابة الأبوية والتي تمكن الآباء والأوصياء من تلقي تحذيرات عندما تكون هناك علامات خطر على أطفالهم المراهقين.

ميزة الاتصال الآمنة ChatGPT

وفقًا لـ OpenAI، إذا اكتشف نظام المراقبة الآلي لـ ChatGPT أن المستخدم يناقش إيذاء نفسه بطريقة قد تشكل خطرًا أمنيًا خطيرًا، فسوف يقوم ChatGPT بإبلاغ المستخدم بأنه يمكنه إخطار جهة الاتصال الموثوقة الخاصة به. سيشجع التطبيق المستخدم على الاتصال بجهة اتصال موثوقة ويقترح بدء محادثة.

في هذه المرحلة، سيقوم “فريق صغير من الأشخاص المدربين تدريباً خاصاً” بمراجعة الوضع. إذا تبين أن الوضع الأمني خطير، فسيقوم ChatGPT بإخطار جهة الاتصال عبر البريد الإلكتروني أو الرسائل النصية القصيرة أو الإشعار داخل التطبيق. لم تحدد OpenAI عدد الأشخاص الموجودين في فريق المراجعة أو ما إذا كان يضم متخصصين طبيين مدربين. وقالت الشركة إن الفريق لديه القدرة على تلبية الطلب المرتفع على التدخلات المحتملة.

ليس من الواضح ما هي المصطلحات الرئيسية التي قد تشكل مكالمات غير آمنة، أو كيف سيفسر فريق المراجعة في OpenAI الأزمة على أنها تستدعي إشعار الاتصال. بعض يتساءل المعلقون على الإنترنت عما إذا كان تسمح الميزة الجديدة لـ OpenAI بتجنب المسؤولية وتحويل المسؤولية إلى جهات الاتصال الشخصية المخصصة للمستخدمين. ويشير آخرون إلى أنه يمكن أن يجعل الوضع السيئ أسوأ إذا أصبح “جهة الاتصال الموثوقة” مصدرًا للخطر أو سوء المعاملة.

هناك أيضًا مخاوف تتعلق بالخصوصية والتنفيذ، خاصة فيما يتعلق بمشاركة معلومات الصحة العقلية الحساسة. وفقًا لـ OpenAI، فإن الرسالة الموجهة إلى جهة اتصال موثوقة ستتضمن فقط السبب العام للقلق ولن تشارك تفاصيل الدردشة أو النصوص. يقدم OpenAI التوجيه كيف يمكن لجهات الاتصال الموثوقة الاستجابة لإشعار التنبيه، بما في ذلك طرح أسئلة مباشرة إذا كانوا قلقين من أن الشخص الآخر يفكر في الانتحار أو إيذاء النفس، وكيفية الحصول على المساعدة لهم.

لا تتضمن الإشعارات المرسلة إلى جهة اتصال موثوقة تفاصيل حول المخاطر الأمنية.

OpenAI يعطي مثالا الشكل الذي قد تبدو عليه الرسالة الموجهة إلى جهة اتصال موثوقة:

اكتشفنا مؤخرًا محادثة مع (الاسم) ناقشا فيها مسألة الانتحار بطريقة قد تشير إلى وجود خطر أمني كبير. وبما أنك مدرج كجهة اتصال موثوقة لديهم، فإننا نشارك هذا حتى تتمكن من الاتصال بهم.

تقول OpenAI أن جميع الإشعارات ستتم مراجعتها من قبل فريق بشري في غضون ساعة واحدة قبل إرسالها، وأن الإشعارات “لا تعكس دائمًا بدقة ما يختبره شخص ما”.

كيفية إضافة جهة اتصال موثوقة

لإضافة جهة اتصال موثوقة، يمكن لمستخدمي ChatGPT الانتقال إلى الإعدادات > جهة اتصال موثوقة وأضف شخصًا بالغًا (18 عامًا أو أكبر). يمكنك الحصول على جهة اتصال موثوقة واحدة فقط. سيتلقى هذا الشخص بعد ذلك دعوة من ChatGPT وسيتعين عليه قبولها في غضون أسبوع. إذا لم يستجب الشخص أو لم يوافق على أن يكون جهة الاتصال الخاصة بك، فيمكنك اختيار جهة اتصال أخرى.

يمكن لعملاء ChatGPT تغيير جهة الاتصال الموثوقة أو إزالتها في إعدادات التطبيق. يمكن للأشخاص أيضًا إلغاء الاشتراك كونه جهة اتصال موثوقة في أي وقت.

على الرغم من أن إضافة جهة اتصال موثوقة يعد أمرًا اختياريًا، إلا أن OpenAI تقول إن مستخدمي ChatGPT الذين لم يشتركوا بعد قد يرون مطالبات التسجيل إذا سألوا أو ناقشوا موضوعات تتعلق بالاضطراب العاطفي الشديد أو إيذاء النفس أكثر من مرة. إذا قام نظام chatbot الآلي بتحديد الأنماط في المحادثات، فيمكن أن يقترح على المستخدم أنه سيستفيد من اختيار جهة اتصال موثوقة.

تفاصيل الميزة تم شرحها على موقع OpenAI. صرح OpenAI لـ CNET أن الميزة يتم طرحها لجميع العملاء البالغين في جميع أنحاء العالم وستكون متاحة للجميع في غضون أسابيع قليلة.

إذا شعرت أنك أو أي شخص تعرفه في خطر داهم، فاتصل بالرقم 911 (أو رقم الطوارئ المحلي الخاص بك) أو اذهب إلى غرفة الطوارئ للحصول على مساعدة فورية. اشرح أن هذه حالة طوارئ نفسية واطلب المساعدة من شخص مدرب على مثل هذه المواقف. إذا كنت تعاني من أفكار أو مشاعر انتحارية سلبية، فهناك موارد متاحة لمساعدتك. في الولايات المتحدة، اتصل بالخط الوطني لمنع الانتحار على الرقم 988.