يعد الذكاء الاصطناعي الذي يمكنه رؤية وفهم ما يحدث في مقطع فيديو – وخاصة البث المباشر – منتجًا جذابًا للعديد من الشركات والمؤسسات. بالإضافة إلى العمل كحارس بوابة لأمن الموقع والمرافق، يمكن أيضًا استخدام نموذج الذكاء الاصطناعي هذا لقص الأجزاء الأكثر إثارة من مقاطع الفيديو التسويقية وإعادة استخدامها للأغراض الاجتماعية، وتحديد التناقضات والأخطاء في مقاطع الفيديو ووضع علامة عليها لإزالتها، وتحديد لغة الجسد وتصرفات المشاركين في التجارب الخاضعة للرقابة أو المرشحين المتقدمين لوظائف جديدة.

في حين أن هناك حاليًا العديد من نماذج الذكاء الاصطناعي التي تقدم هذا النوع من الوظائف، إلا أنها بعيدة كل البعد عن كونها ميزة سائدة. ومع ذلك، فإن شركة Perceptron Inc الناشئة البالغة من العمر عامين، تريد تغيير كل هذا. واليوم أعلن عن إطلاق سراحه نموذج الاستدلال الرائد لتحليلات الفيديو، Mk1 (اختصار لـ “Mark One”) بتكلفة 0.15 دولار لكل مليون رمز إدخال / 1.50 دولار لكل مليون إخراج عبر واجهة برمجة التطبيقات (API) – وهو ما يقرب من 80-90٪ أقل من المنافسين الرئيسيين الآخرين، وهم Anthropic’s Claude Sonnet 4.5، وGPT-5 من OpenAI، وGemini 3.1 Pro من Google.

بقيادة المؤسس المشارك والرئيس التنفيذي أرمين أغاجانيان، الذي كان يعمل سابقًا في Meta FAIR وMicrosoft، أمضت الشركة 16 شهرًا في تطوير “وصفة متعددة الوسائط” من الصفر لمراعاة تعقيدات العالم المادي.

يشير هذا الإطلاق إلى حقبة جديدة من المتوقع أن تفهم فيها النماذج السبب والنتيجة، وديناميكيات الأشياء، وقوانين الفيزياء بنفس السلاسة التي طبقتها من قبل على القواعد.

يمكن للمستخدمين المهتمين والعملاء المحتملين من المؤسسات تجربة ذلك بأنفسهم على المنصة موقع Perceptron التجريبي العام هنا.

الأداء في الاختبارات المكانية والفيديو

يتم دعم أداء النموذج من خلال مجموعة من المعايير القياسية التي تركز على الفهم المبني على أسس.

في الاستدلال المكاني (معايير ER)، حقق Mk1 درجة 85.1 على EmbSpatialBench، متفوقًا على Google Robotics-ER 1.5 (78.4) وQ3.5-27B من Alibaba (حوالي 84.5).

في اختبار RefSpatialBench المتخصص، تعد درجة Mk1 البالغة 72.4 قفزة هائلة على المنافسين مثل GPT-5m (9.0) وSonnet 4.5 (2.2)، مما يسلط الضوء على ميزة كبيرة في فهم التعبيرات المرجعية.

وتظهر معايير الفيديو هيمنة مماثلة؛ في “المجموعة الفرعية الصلبة” الخاصة بـ EgoSchema – حيث يكون الاستدلال من الإطارين الأول والأخير غير كافٍ – سجل Mk1 41.4، وهو ما يعادل Q3.5-27B الخاص بـ Alibaba ويتفوق بشكل ملحوظ على Gemini 3.1 Flash-Lite (25.0).

في اختبار VSI-Bench، حقق Mk1 88.5، وهي أعلى درجة مسجلة بين النماذج التي تمت مقارنتها، مما يؤكد أيضًا قدرته على التعامل مع مهام الاستدلال الزمني في العالم الحقيقي.

تحديد المواقع في السوق وحدود الكفاءة

استهدفت شركة Perceptron بشكل صريح “حدود الكفاءة”، وهو مقياس يرسم متوسط الأداء في الفيديو ويجسد أنماط التفكير مقابل التكلفة المختلطة لكل مليون رمز مميز.

تظهر بيانات المقارنة أن Mk1 في وضع فريد: فهو يطابق أو يتجاوز أداء نماذج “الواجهة الأمامية” مثل GPT-5 وGemini 3.1 Pro، مع الحفاظ على ملف تعريف التكلفة أقرب إلى إصدارات “Lite” أو “Flash”.

على وجه التحديد، سعر Perceptron Mk1 هو 0.15 دولار لكل مليون رمز إدخال و1.50 دولار لكل مليون رمز إخراج. للمقارنة، يُظهر مخطط “Efficiency Frontier” GPT-5 بتكلفة مختلطة أعلى بكثير (قريبة من 2.00 دولار أمريكي) وGemini 3.1 Pro بسعر 3.00 دولار أمريكي تقريبًا، بينما يصنف Mk1 بتكلفة مختلطة قدرها 0.30 دولار أمريكي ويقدم درجات ممتازة في الاستدلال.

وتهدف استراتيجية التسعير العدوانية هذه إلى جعل الذكاء الاصطناعي المادي المتطور متاحًا للتطبيقات الصناعية واسعة النطاق، وليس فقط الأبحاث التجريبية.

العمارة والاستمرارية الزمنية

يتمثل الجوهر التقني لـ Perceptron Mk1 في قدرته على معالجة الفيديو الأصلي بمعدل يصل إلى إطارين في الثانية (FPS) ضمن نافذة سياق رمزية كبيرة تبلغ 32 كيلو بايت.

على عكس نماذج اللغة المرئية التقليدية (VLM)، التي غالبًا ما تتعامل مع الفيديو على أنه تسلسل منفصل من الصور الثابتة، تم تصميم Mk1 مع أخذ الاستمرارية الزمنية في الاعتبار.

تسمح هذه البنية للنموذج “بمراقبة” التدفقات الممتدة والحفاظ على هوية الكائن حتى في حالة وجود الانسداد، وهو مطلب بالغ الأهمية في تطبيقات الروبوتات والمراقبة.

يمكن للمطورين الاستعلام عن النموذج لحظات محددة في تدفق طويل والحصول على رموز زمنية منظمة في المقابل، مما يؤدي إلى تبسيط عملية قطع الفيديو واكتشاف الأحداث.

الاستدلال بقوانين الفيزياء

السمة المميزة الرئيسية لـ Mk1 هي قدرتها على “التفكير جسديًا”. يعرّف Perceptron هذا بأنه وعي مكاني دقيق يسمح للنموذج بفهم ديناميكيات الكائن والتفاعلات المادية في إعدادات العالم الحقيقي.

على سبيل المثال، يمكن للنموذج تحليل مشهد ما لتحديد ما إذا كانت تسديدة كرة السلة قد تم التقاطها قبل أو بعد الجرس من خلال التفكير معًا حول موضع الكرة في الهواء وقراءة ساعة التسديد.

وهذا يتطلب أكثر من مجرد التعرف على الأنماط؛ يتطلب فهم كيفية تحرك الأشياء في المكان والزمان.

يمكن للنموذج الإشارة والعد بالمئات في مشاهد كثيفة ومعقدة “بدقة البكسل”. ويمكنه أيضًا قراءة أجهزة القياس والساعات التناظرية التي كان من الصعب تاريخيًا تفسيرها بموثوقية عالية في أنظمة الرؤية الرقمية البحتة.

ويبدو أيضًا أن لديه معرفة عامة قوية بالعالم والتاريخ. في اختباري القصير، قمت بتحميل نطاق عام تاريخي فيلم يظهر بناء ناطحة سحاب في نيويورك عام 1906 من مكتبة الكونجرس الأمريكية، ولم يكن Mk1 قادرًا فقط على وصف محتويات اللقطات بشكل صحيح – بما في ذلك المشاهد الغريبة وغير العادية مثل العمال المعلقين بالحبال – ولكنه فعل ذلك بسرعة وحتى حدد بشكل صحيح التاريخ التقريبي (أوائل القرن العشرين) بناءً على مظهر اللقطات وحدها.

منصة تطوير للذكاء الاصطناعي المادي

يأتي إصدار النموذج مزودًا بمنصة تطوير محسنة مصممة لتحويل قدرات الإدراك المتقدمة هذه إلى تطبيقات وظيفية بأقل قدر من التعليمات البرمجية.

يقدم Perceptron SDK، المتوفر في لغة Python، العديد من الميزات المتخصصة مثل “التركيز” و”العد” و”التعلم السياقي”.

يتيح التركيز للمستخدمين تكبير/تصغير مناطق محددة من الإطار واقتصاصها تلقائيًا بناءً على مطالبات اللغة الطبيعية، مثل اكتشاف معدات الحماية الشخصية (PPE) وتحديد موقعها في موقع البناء. تم تحسين وظيفة العد للمشاهد الكثيفة، مثل تحديد كل جرو والإشارة إليه في مجموعة أو منتجات فردية.

علاوة على ذلك، تدعم المنصة التعلم السياقي، مما يسمح للمطورين بتخصيص Mk1 لمهام محددة من خلال تقديم أمثلة قليلة فقط، مثل عرض صورة تفاحة وإخبار النموذج بوصف كل مثيل من الفئة 1 في مشهد جديد.

استراتيجيات الترخيص وسلسلة إسحاق

تمتلك شركة Perceptron استراتيجية ذات شقين عندما يتعلق الأمر بأوزان نماذجها وتراخيصها. إن جهاز Perceptron Mk1 الرائد هو نموذج مغلق المصدر يمكن الوصول إليه عبر واجهة برمجة التطبيقات (API)، وهو مصمم مع وضع الأداء والأمان على مستوى المؤسسات في الاعتبار.

ومع ذلك، تواصل الشركة أيضًا سلسلة “إسحاق” التي بدأت بها إطلاق Isaac 0.1 في سبتمبر 2025كبديل بالأوزان المفتوحة. إسحاق 0.2-2ب-معاينةتم إصداره في ديسمبر 2025، وهو عبارة عن نموذج لغة رؤية يضم 2 مليار معلمة مع إمكانات استدلال متاحة لعمليات نشر الحافة وزمن الوصول المنخفض.

في حين أن أوزان نموذج إسحاق مفتوحة في مجتمع مشاركة كود الذكاء الاصطناعي الشهير معانقة الوجهتقدم Perceptron تراخيص تجارية للشركات التي تتطلب أقصى قدر من التحكم أو التنفيذ على نطاق محلي.

يسمح هذا النهج للشركة بدعم كل من مجتمع المصادر المفتوحة والشركاء الصناعيين المتخصصين الذين يحتاجون إلى مرونة الملكية. تشير الوثائق إلى أن نماذج Isaac 0.2 تم تحسينها خصيصًا لوقت أول رمز مميز يقل عن 200 مللي ثانية، مما يجعلها مثالية لأجهزة الحافة في الوقت الفعلي.

معلومات أساسية عن تأسيس وتركيز Perceptron

Perceptron AI هي شركة ناشئة في مجال الذكاء الاصطناعي، مقرها في بلفيو، واشنطن، أسسها أغاجانيان وأكشات شريفاستافا، العلماء السابقون في مختبر Meta Facebook AI Research (FAIR).

المواد العامة للشركة تؤرخ تأسيسها إلى نوفمبر 2024، في حين أن إيداعات الشركة في واشنطن لصالح شركة Perceptron.ai Inc. طلب مسبق للتسجيل الأجنبي في 9 أكتوبر 2024تسمية شريفاستافا وأغاجانيان حاكمين.

في مشاركات المؤسسين من أواخر عام 2024 أغاجانيان قال إنه ترك ميتا بعد ما يقرب من ست سنوات و”تضافر جهوده” مع شريفاستافا لبناء ذكاء اصطناعي للعالم المادي، بينما قال شريفاستافا إن الشركة نمت من عمله في مجال الأداء والوسائط المتعددة والنماذج الجديدة.

يبدو أن تأسيس الشركة جاء كنتيجة مباشرة لعمل الثنائي على نماذج الأساس متعددة الوسائط في Meta. في مايو 2024 نشر باحثون ميتا كتاب الحرباءعائلة من نماذج الاندماج المبكرة المصممة لفهم وإنشاء تسلسلات مختلطة من النصوص والصور، وهو العمل الذي وصفه بيرسبترون لاحقًا بأنه جزء من مجموعة من النماذج الداخلية الخاصة به.

يوليو 2024 الوثيقة الداعمة، مومااستكشف التدريب التوليفي المبكر الأكثر فعالية للنماذج المختلطة وأدرج كلا من شريفاستافا وأغاجانيان بين المؤلفين. توسع أطروحة بيرسبترون هذا الخط من البحث ليشمل “الذكاء الاصطناعي المادي”: النماذج التي يمكنها معالجة تدفقات الفيديو في العالم الحقيقي وغيرها من التدفقات الحسية لتطبيقات مثل الروبوتات، والتصنيع، والتحليل الجغرافي المكاني، والأمن، والإشراف على المحتوى.

النظم البيئية الشريكة والآفاق المستقبلية

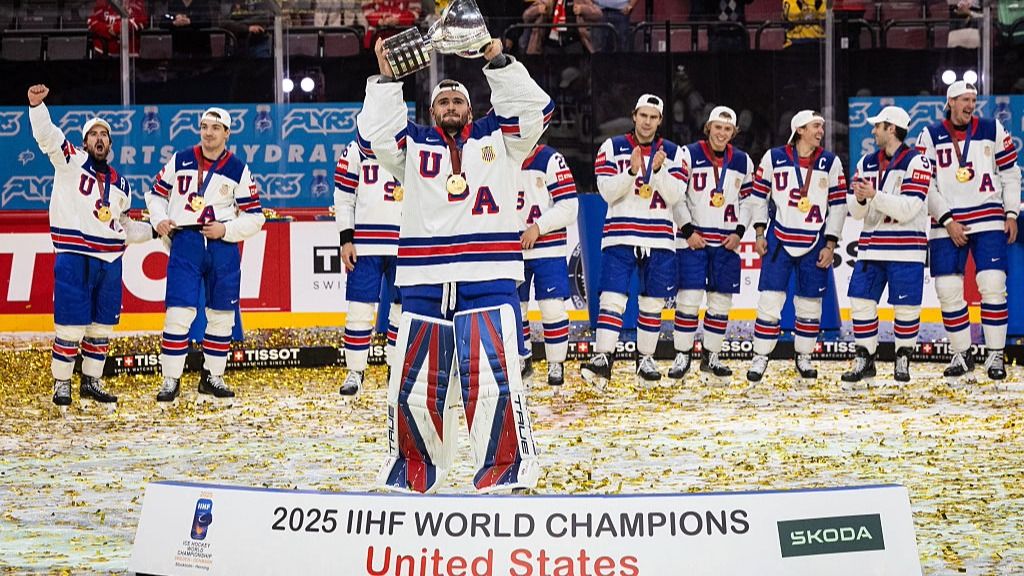

تُظهر شبكة شركاء Perceptron بالفعل التأثير الحقيقي لـ Mk1 على العالم. يستخدم المتبنون الأوائل النموذج لمجموعة متنوعة من التطبيقات، مثل قص مقاطع الأحداث الرياضية الحية تلقائيًا، والذي يستخدم معرفة النموذج بمرور الوقت لتحديد المسرحيات الرئيسية دون تدخل بشري.

وفي قطاع الروبوتات، يقوم الشركاء بتحويل حلقات التشغيل عن بعد إلى بيانات تدريب، مما يؤدي بشكل فعال إلى أتمتة عملية تصنيف البيانات وتطهيرها للأذرع الروبوتية والوحدات المتنقلة.

وتشمل حالات الاستخدام الأخرى عوامل مراقبة الجودة متعددة الوسائط على خطوط الإنتاج التي يمكنها اكتشاف العيوب والتحقق من خطوات التجميع في الوقت الفعلي، بالإضافة إلى المساعدات القابلة للارتداء على النظارات الذكية التي توفر مساعدة حساسة للسياق للمستخدمين.

وقال أغاجانيان إن هذه المنشورات هي تتويج للأبحاث التي تهدف إلى ضمان أن الذكاء الاصطناعي يمكن أن يعمل بشكل أفضل في العالم المادي، والتحرك نحو مستقبل حيث يكون “الذكاء الاصطناعي المادي” في كل مكان مثل الذكاء الاصطناعي الرقمي.