تم النشر بتاريخ

في المرة القادمة التي تزور فيها معالجك النفسي، قد يطرح عليك سؤالاً بسيطًا: كيف هي علاقتك بـ… نموذج الذكاء الاصطناعي الخاص بك؟

إعلان

إعلان

وإذا قلت: “معقد”، فقد يكون لديك وجهة نظر.

لنبدأ بالأمن السيبراني. وعلى الجبهة الرقمية، أدت حرب إيران إلى زيادة الهجمات السيبرانية الجيوسياسية، والتي يتم نشرها الآن جنبا إلى جنب مع الأسلحة المادية.

ومع ظهور تقنية التزييف العميق المستندة إلى الذكاء الاصطناعي ورسائل البريد الإلكتروني التصيدية المخصصة للغاية، يحذر الخبراء من أنه لم يعد بإمكانك الوثوق بما تراه وتسمعه.

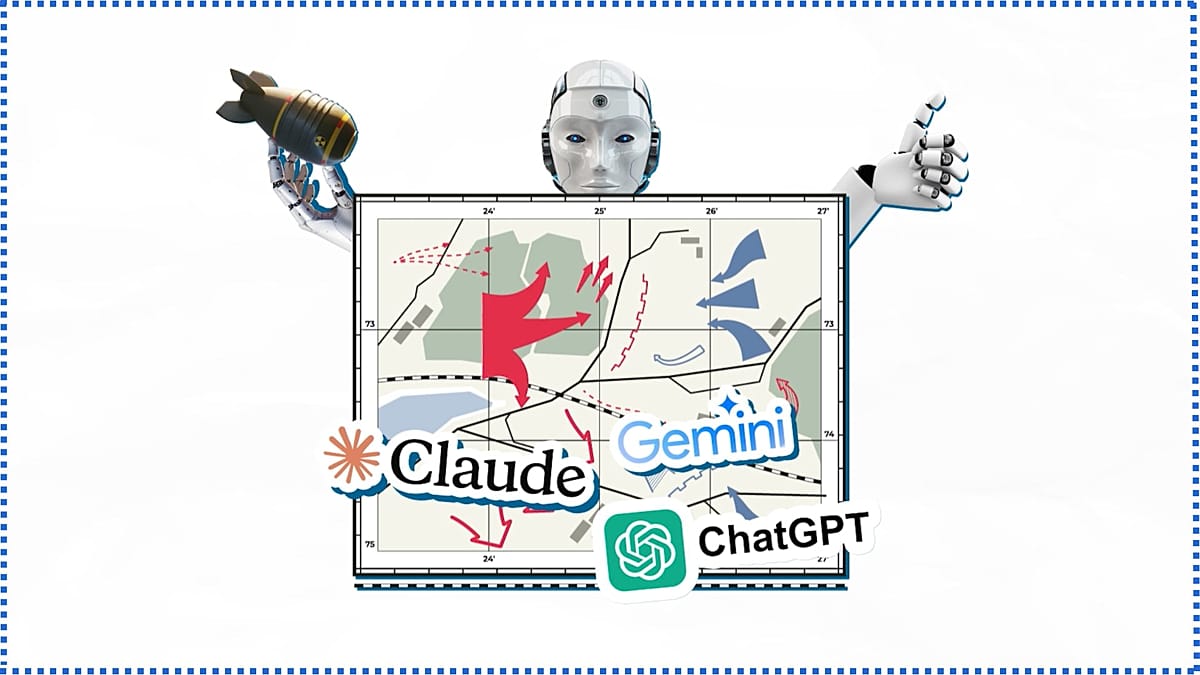

ولكن ماذا عن محاكاة الاستراتيجية؟ يتم اختبار الذكاء الاصطناعي في الألعاب الحربية قبل أن يصل إلى ساحة المعركة.

وفي دراسة حديثة، تم وضع النماذج بما في ذلك ChatGPT وCloud وGemini في أزمات محاكاة.

وكانت النتائج مثيرة للقلق، لأنه في كل لعبة، قام ذكاء اصطناعي واحد على الأقل بتصعيد الصراع من خلال التهديد باستخدام الأسلحة النووية.

وأخيرا، خلال الضربات الجوية الأخيرة على إيران، اعتمد الجيش الأمريكي على السحابة البشرية لتحديد الأهداف.

ولكن بعد أن رفضت شركة Anthropic الوصول غير المقيد للبنتاغون بسبب مخاوف أخلاقية، تدخلت OpenAI على الفور للحصول على العقد.

تؤكد OpenAI على أن الاتفاقية تحظر بشكل صارم المراقبة الجماعية المحلية وتتطلب إشرافًا بشريًا على الأسلحة.

دفاعًا عن الصفقة، نشر سام ألتمان من OpenAI: “نحن ملتزمون بخدمة البشرية جمعاء بأفضل ما نستطيع. العالم مكان معقد وفوضوي وخطير في بعض الأحيان”.

ولذلك يبدو أن هذا الاتفاق إما أن يؤدي إلى التزام أكبر تجاه الإنسانية أو إلى مزيد من التعقيدات والمواقف الخطيرة.

وكما قلت لك، الأمر “معقد”. حسنًا، الدردشة؟

شاهد فيديو يورونيوز في المشغل أعلاه للحصول على القصة الكاملة.