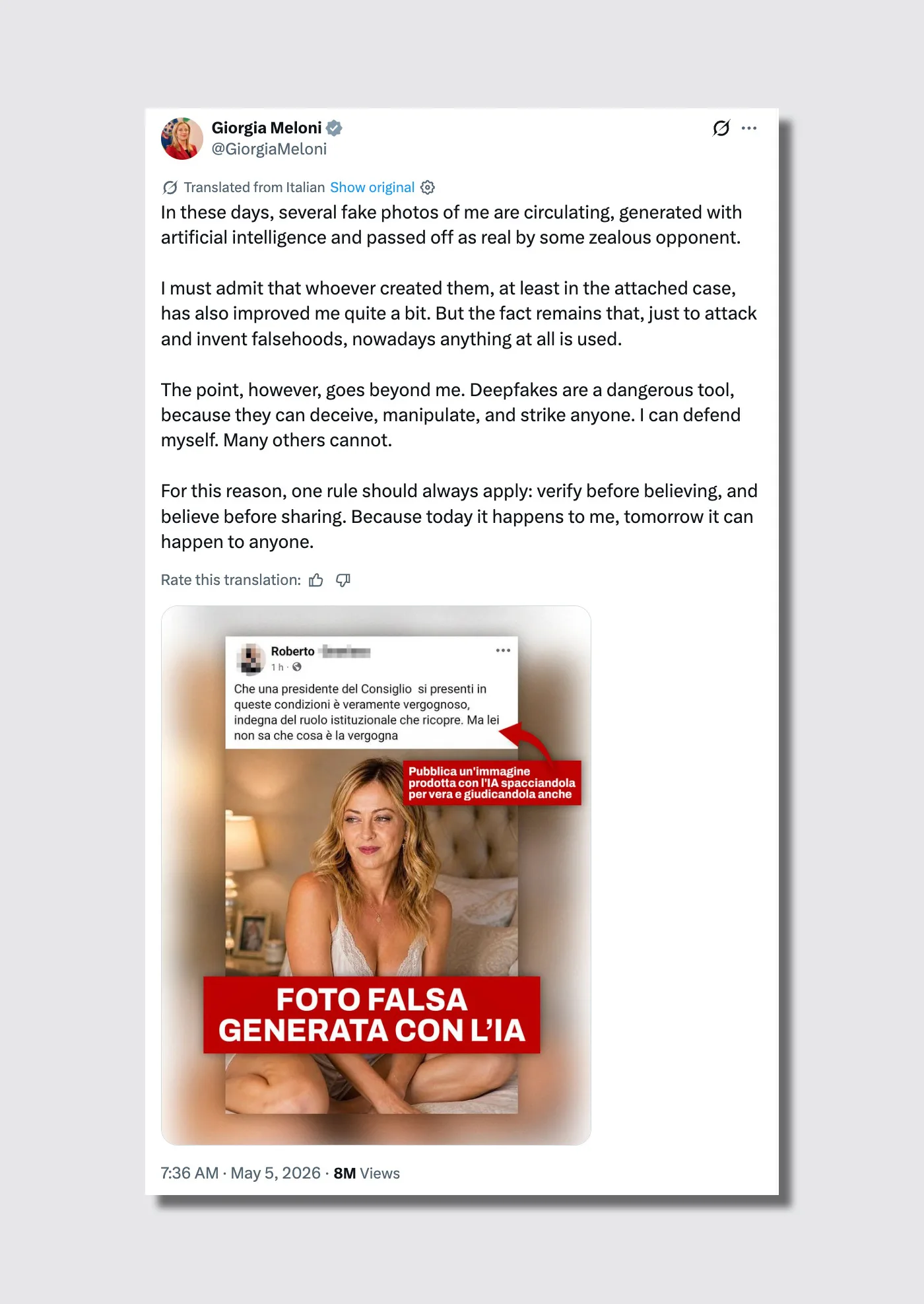

بالأمس، جورجيا ميلوني نشر بالنسبة لـ X، صورة تم إنشاؤها بواسطة الذكاء الاصطناعي وهي لا ترتدي سوى الملابس الداخلية. نشر رئيس الوزراء الإيطالي الصورة لتحذير الآخرين من مدى سهولة إنشاء صور ومقاطع فيديو يمكن تصديقها تمامًا. تحذيرك: لا تصدق أبدًا أي شيء تراه دون التحقق من الحقائق بدقة.

ففي النهاية، نحن نعيش في نهاية الواقع.

قالت ميلوني على قناة X: “التزييف العميق أداة خطيرة لأنها يمكن أن تخدع أي شخص وتتلاعب به وتستهدفه. أستطيع الدفاع عن نفسي، لكن كثيرين آخرين لا يستطيعون ذلك”.

إنها على حق، على الرغم من أن الصورة ليست مزيفة من الناحية الفنية. (إنها صورة تم إنشاؤها بواسطة الذكاء الاصطناعي بالكامل وتظهر وجهها.) على عكس التزييف العميق، الذي يقوم فقط بتبديل وجه الإنسان في صورة مصدر أساسية مع وجه إنسان آخر، يمكن للذكاء الاصطناعي التوليدي استخدام مكونات مختلفة – مثل الوجوه الحقيقية والأجساد والأماكن والأصوات والأصوات – لإنشاء وسائط اصطناعية جديدة بنسبة 100٪.

هذه العملية تجعل طبيعتها الحقيقية غير قابلة للاكتشاف تقريبًا، إن لم يكن بشكل كامل: نظرًا لأنه لا يمكنك عكس البحث ومطابقة الصورة الأساسية بمصدر أصلي على الويب، يمكنك الاعتقاد بأنها أصلية (وحقيقية).

ميلوني لديه وقد رفعت بالفعل دعوى قضائية ضد رجلين لإنشاء مقطع فيديو إباحي مزيف عميق لها في عام 2024. هذه المرة، قالت مازحة إن الصور المزيفة تبدو أفضل “كثيرًا” منها ونشرت الصورة كإعلان خدمة عامة لعام 2026. وكتبت: “لهذا السبب يجب دائمًا تطبيق قاعدة واحدة: تحقق قبل أن تصدق وصدق قبل أن تشارك. لأنه اليوم يحدث لي، وغدًا يمكن أن يحدث لأي شخص”.

أظهر ميلوني شجاعته من خلال الكشف عن نفسه، حيث كان عليه أن يفعل أكثر من مجرد تقديم النصيحة. نحن طريق أبعد من نقطة التعليم. العالم بحاجة إلى العمل.

يشكل الذكاء الاصطناعي التوليدي خطراً وجودياً على البشرية. ويمكنه استخدام تحيزاتنا النفسية كسلاح، مما يدمر بشكل فعال إحساسنا المشترك بالواقع الموضوعي.

مجرد إلقاء نظرة على الأشهر القليلة الماضية. هناك جيسيكا فوستر، وهي مؤثرة عسكرية مؤيدة لترامب أنشأها الذكاء الاصطناعي، والتي جمعت مليون متابع في ثلاثة أشهر فقط لتوجيه الرجال إلى موقع ويب خاص بالبالغين (أصبح حسابها لاحقًا محذوفة من الانستقرام). وعلى الرغم من أن شخصيته الرقمية كانت مليئة بالعيوب الواضحة والسيناريوهات السخيفة، على عكس صور ميلوني، فقد تجاهلها أتباعه عمدًا لأن السراب يرضي خيالاتهم الأيديولوجية تمامًا.

عندما تم نشر مقطع فيديو شرعي يثبت أن رئيس الوزراء الإسرائيلي بنيامين نتنياهو كان على قيد الحياة بعد شائعات عن اغتياله، رفضت شبكة الإنترنت ــ بمساعدة روبوتات الدردشة المحيرة للعقل التي تعمل بالذكاء الاصطناعي ــ على الفور وبصورة زائفة اللقطات باعتبارها مزيفة بعمق. وحتى بعد أن قدم المحللون المستقلون ومدققو الحقائق أدلة دامغة على أن الفيديو كان حقيقيا، فشلت الأدلة في التأثير على أولئك الذين فضلوا نظريات المؤامرة الخاصة بهم.

ويجب على كل سياسي أن يتحرك الآن

يحتاج المجتمع، الواقع في فخ هذا الواقع المرير غير الواقعي، حيث تم تبخير محيط الحقيقة الموضوعية بالكامل من قبل عمالقة التكنولوجيا، إلى أكثر من مجرد مشاركة X. ولم تعد حملات التوعية العامة والتثقيف كافية لمكافحة التكلفة البشرية والاقتصادية الهائلة التي يسببها هذا الأمر بالفعل.

إن استراتيجية الخروج الوحيدة المتبقية لإنقاذ واقعنا المشترك هي أن تتدخل الحكومات العالمية بقوة وتجبر شركات التكنولوجيا على اعتماد أجهزة وبرامج يمكنها التحقق من صحة الصور ومقاطع الفيديو والصوت الحقيقية دون أدنى شك.

في شهر مارس، اقترح فريق من ETH Zurich الحل الوحيد الذي يبدو جديًا بدرجة كافية بالنسبة لحجم التهديد: أجهزة استشعار تقوم بتوقيع الصورة بشكل مشفر في اللحظة المحددة التي يضربها فيها الضوء والصوت.

على عكس الأنظمة الحالية، التي تختم الأصالة لاحقًا عبر المعالج الرئيسي للجهاز وبالتالي يمكن اعتراضها أو خداعها، فإن هذا التصميم يقفل عملية التحقق مباشرة في عملية الالتقاط نفسها.

بعبارات بسيطة، سيكون من الأصعب بكثير تمرير الوسائط الاصطناعية على أنها حقيقية، لأن إثبات الأصالة سيولد داخل الأجهزة، ولن تتم إضافته لاحقًا بواسطة برامج يمكن تزويرها. وبهذه الطريقة، يمكن للناس البحث عن “ختم الحقيقة” في أي وسيلة إعلامية منشورة في كل مكان، من المطبوعات إلى شبكات التواصل الاجتماعي.

وأي شيء لا يحمل هذا الختم، كما تقول ميلوني، يجب أن يتم التشكيك فيه وتجاهله تلقائيًا.

ويجب على الدول أيضًا أن تعمل على تزويد مواطنيها بالأدوات اللازمة لإزالة أي صور تستخدم وجوههم، وتمكين القوانين مثل قانون الألفية الجديدة لحقوق طبع ونشر المواد الرقمية في الولايات المتحدة. ولكن بدلاً من إجبار الأشخاص العاديين على امتلاك حقوق الطبع والنشر، يجب أن يكونوا قادرين بسهولة على إزالة أي إصدارات غير مصرح بها من الذكاء الاصطناعي لأنفسهم على أي شبكة ويب عامة أو شبكة اجتماعية.

وفي الوقت الحالي، لم تفعل ذلك سوى الحكومة الدنماركية. وفي محاولة لتوفير الحماية ضد استنساخ الذكاء الاصطناعي لمواطنيها، أعادت البلاد في العام الماضي كتابة قانونها القانوني لضمان احتفاظ السكان بشكل صارم بحقوقهم في وجوههم البيولوجية وأصواتهم الطبيعية.

وقد لخص وزير الثقافة الدنماركي، جاكوب إنجل شميدت، الوضع بشكل مثالي في ذلك الوقت: “يمكن للبشر أن يمروا عبر آلة التصوير الرقمية وأن يساء استخدامهم لجميع أنواع الأغراض وأنا لست على استعداد لقبول ذلك”.

إن قضية ميلوني، وهي واحدة من بين الملايين، تظهر مرة أخرى أن وزير الثقافة الدنماركي كان على حق بنسبة 200% عندما أعلن مدى إلحاح القانون الذي وافقت عليه حكومته. ويتعين علينا أن نعمل على إنهاء هذه المشكلة بشكل حاسم باستخدام هذه الأدوات، وأي أدوات أخرى يستطيع صناع السياسات والمهندسون إيجادها.

الصور الزائفة – طالما أنها ضمن الحدود القانونية القائمة – يمكن أن تتعايش بشكل مثالي مع الواقع. ولكن يتعين على عمالقة التكنولوجيا المستفيدين من هذه المشكلة أن يتحركوا الآن.