أحد التحديات الرئيسية لبناء عملاء ذكاء اصطناعي فعال هو تعليمهم الاختيار بين استخدام أدوات خارجية أو الاعتماد على المعرفة الداخلية. ومع ذلك، غالبًا ما يتم تدريب نماذج اللغات الكبيرة على الرجوع إلى الأدوات بشكل أعمى، مما يؤدي إلى اختناقات في زمن الاستجابة، وتكاليف واجهة برمجة التطبيقات غير الضرورية، وتدهور المنطق بسبب الضوضاء المحيطة.

للتغلب على هذا التحدي، قدم الباحثون في علي بابا تحسين السياسة الهرمية المنفصلة (HDPO)، وهي عبارة عن منصة للتعلم المعزز تقوم بتدريب الوكلاء على تحقيق التوازن بين كفاءة التنفيذ ودقة المهام.

يعمل نموذج Metis متعدد الوسائط الذي تم تدريبه باستخدام هذا الإطار على تقليل استدعاءات الأدوات الزائدة من 98% إلى 2% فقط مع إنشاء دقة استدلال جديدة ومتطورة في معايير الصناعة الرئيسية. تساعد هذه المنصة على إنشاء وكلاء الذكاء الاصطناعي الذين لا يخشون التحفيز ويعرفون متى يتراجعون، مما يتيح تطوير أنظمة وكلاء سريعة الاستجابة وفعالة من حيث التكلفة.

العجز ما وراء المعرفي

تواجه النماذج الفاعلية الحالية ما يسميه الباحثون “العجز ما وراء المعرفي العميق”. من الصعب على النماذج أن تقرر متى تستخدم معرفتها البارامترية الداخلية ومتى تستعلم عن أداة خارجية. ونتيجة لذلك، يقومون باستدعاء الأدوات وواجهات برمجة التطبيقات بشكل أعمى، مثل بحث الويب أو تنفيذ التعليمات البرمجية، حتى لو كانت مطالبة المستخدم تحتوي بالفعل على جميع المعلومات اللازمة لحل المهمة.

يؤدي هذا السلوك المثير عند استدعاء الأدوات إلى إنشاء عقبات تشغيلية خطيرة في التطبيقات الحقيقية. ونظرًا لأن النماذج مدربة على التركيز بشكل حصري تقريبًا على إكمال المهمة، فهي غير مبالية بالتأخير. غالبًا ما يطلب هؤلاء الوكلاء أسعارًا باهظة لاستدعاءات الأدوات. يؤدي كل استدعاء خارجي غير ضروري لواجهة برمجة التطبيقات (API) إلى حدوث اختناق في المعالجة التسلسلية، مما يحول الذكاء الاصطناعي السليم من الناحية الفنية إلى نظام بطيء يحبط المستخدمين ويستنزف ميزانيات الأدوات.

وفي الوقت نفسه، فإن حرق الموارد الحسابية بسبب الاستخدام المفرط للأدوات لا يُترجم إلى تفكير أفضل. تدخل تفاعلات الأداة الزائدة عن الحاجة ضوضاء في سياق النموذج. يمكن أن يؤدي هذا الضجيج إلى تشتيت انتباه النموذج، مما يؤدي إلى إخراج سلسلة التفكير السليمة عن مسارها والإضرار بالنتيجة النهائية.

لمعالجة زمن الوصول والنفقات العامة للاستدعاء الأعمى للأدوات، حاولت أساليب التعلم المعزز السابقة معاقبة الاستخدام المفرط للأداة من خلال الجمع بين دقة المهمة وكفاءة التنفيذ في إشارة مكافأة واحدة. ومع ذلك، فإن هذا التصميم المتشابك يخلق معضلة تحسين غير قابلة للحل. إذا كانت عقوبة الأداء شديدة للغاية، يصبح النموذج محافظًا للغاية ويحد من استخدام الأدوات الضرورية، ويضحي بالصواب من أجل المهام الشاقة. على العكس من ذلك، إذا كانت العقوبة خفيفة، تفقد إشارة التحسين قيمتها ولا تمنع الإفراط في استخدام الأداة للقيام بمهام أبسط.

علاوة على ذلك، فإن هذه المكافأة المشتركة تخلق غموضًا دلاليًا، حيث قد يؤدي المسار غير الدقيق مع عدم استدعاء الأداة إلى نفس المكافأة مثل المسار الدقيق مع استدعاء الأداة المفرط. نظرًا لأن إشارات التدريب الخاصة بالدقة والأداء تصبح مشوشة، لا يمكن للنموذج أن يتعلم التحكم في استخدام الأداة دون المساس بقدراته المنطقية الأساسية.

تحسين السياسة المنفصلة الهرمية

لحل معضلة تحسين المكافآت المزدوجة، قدم الباحثون تقنية HDPO. تقوم HDPO بتقسيم الدقة والأداء إلى قناتين مستقلتين للتحسين. تركز قناة الدقة على تعظيم صحة المهام عبر جميع عمليات تنفيذ النماذج. تم تحسين قناة الأداء لتحقيق الاقتصاد في التنفيذ.

يقوم HDPO بحساب إشارات التدريب لهاتين القناتين بشكل مستقل ولا يجمعها إلا في المرحلة النهائية من حساب الخسارة. تعتمد إشارة الأداء على قناة الدقة. وهذا يعني أن الاستجابة غير الصحيحة لا تتم مكافأتها أبدًا لمجرد السرعة أو استخدام أدوات أقل. يتجنب هذا الفصل المواقف التي تلغي فيها تدرجات الدقة والأداء بعضها البعض، مما يوفر للذكاء الاصطناعي إشارات تعلم نظيفة لكلا الغرضين.

أقوى خاصية ناشئة لهذا التصميم المنفصل هي أنه ينشئ برنامجًا معرفيًا مخفيًا. في بداية التدريب، عندما لا يزال النموذج يعاني من المهمة، يهيمن هدف الدقة على التحسين، مما يجبر النموذج على إعطاء الأولوية لتعلم المنطق والمعرفة الصحيحة. ومع نضوج القدرات الاستدلالية للنموذج وإنتاجها الإجابات الصحيحة باستمرار، تزداد إشارة الأداء بسلاسة. تؤدي هذه الآلية إلى قيام النموذج أولاً بإتقان حل المهام وبعد ذلك فقط تحسين استقلاليته، وتجنب استدعاءات واجهة برمجة التطبيقات (API) غير الضرورية والمكلفة.

لاستكمال HDPO، طور الباحثون نظامًا صارمًا ومتعدد الخطوات للتحقق من صحة البيانات يعالج العيوب الخطيرة الموجودة في مجموعات البيانات الحالية المدعومة بالأدوات. تتضمن عملية التحقق من صحة البيانات الخاصة بهم خطوات الضبط الدقيق الخاضع للإشراف (SFT) والتعلم المعزز (RL).

بالنسبة لمرحلة SFT، حصلوا على البيانات من مسارات الوسائط المتعددة المدعومة بالأدوات المتاحة للجمهور وقاموا بتصفيتها لإزالة الأمثلة منخفضة الجودة التي تحتوي على أخطاء في التنفيذ أو تناقضات في التعليقات. كما قاموا أيضًا بتصفية أي عينات تدريبية يمكن للنموذج الأساسي حلها مباشرة بدون أدوات. وأخيرًا، باستخدام Google Gemini 3.1 Pro كتقييم آلي، تمت تصفية مجموعة SFT للاحتفاظ فقط بالأمثلة التي أظهرت استخدام الأدوات الإستراتيجية.

بالنسبة لمرحلة RL، ركز المنسق على ضمان إشارة تحسين مستقرة. لقد قاموا بتصفية التلميحات ذات الصور المكسورة أو الغموض الدلالي. تعتمد خوارزمية HDPO على مقارنة الإجابات الصحيحة وغير الصحيحة. إذا كانت المهمة سهلة إلى حد تافه عندما يقوم النموذج دائمًا بتنفيذها بشكل صحيح، أو صعبة للغاية عندما يفشل النموذج دائمًا، فلن يكون هناك تباين رياضي كبير يمكن التعلم منه. اتبع الفريق بدقة المطالبات التي تحتوي على مزيج غير تافه من النجاحات والإخفاقات لضمان إشارة تدرج قابلة للتنفيذ.

العميل ميتيس: HDPO في العمل

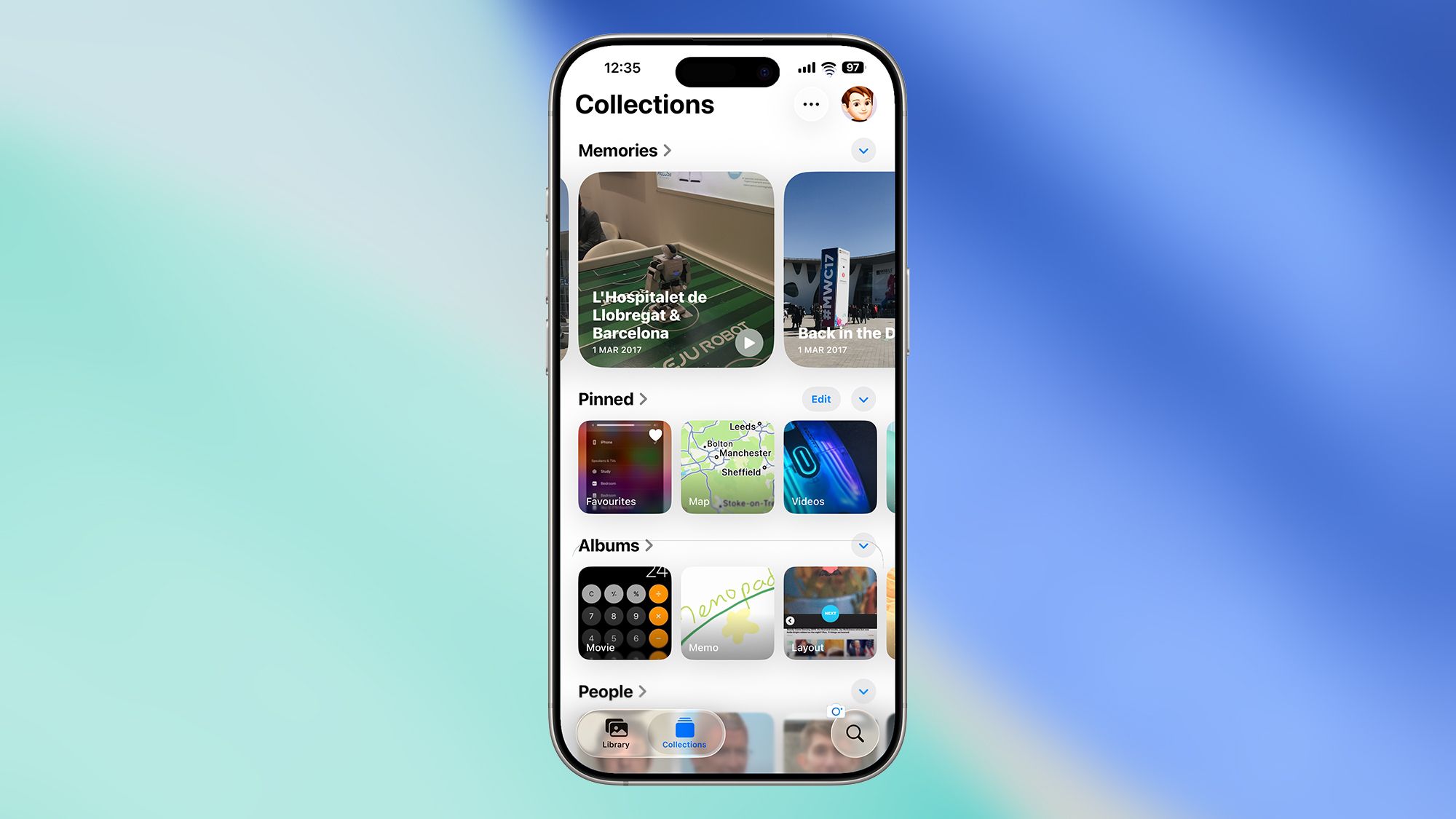

ولاختبار HDPO عمليًا، استخدم الباحثون المنصة لتطوير Metis، وهو وكيل استدلال متعدد الوسائط مزود بأدوات الترميز والبحث. تم بناء Metis على أساس نموذج لغة الرؤية Qwen3-VL-8B-Instruct. وقام الباحثون بتدريبه على مرحلتين منفصلتين. أولاً، قاموا بتطبيق SFT باستخدام بيانات محددة لضمان تهيئة البدء البارد. ثم قاموا بتطبيق RL باستخدام إطار عمل HDPO، مما أدى إلى تعريض النموذج لتفاعلات متعددة المنعطفات حيث يمكنه استدعاء أدوات مثل تنفيذ تعليمات برمجية Python والبحث عن النص والبحث عن الصور.

قارن الباحثون Metis مع نماذج الرؤية القياسية مفتوحة المصدر مثل LLaVA-OneVision، وأدوات التفكير النصي، والنماذج الحديثة القائمة على الوكيل بما في ذلك DeepEyes V2 وSkywork-R1V4 مع 30 مليار معلمة. غطى التقييم مجالين رئيسيين: الإدراك البصري وفهم المستندات، ومجموعات البيانات مثل HRBench وV*Bench، والمهام الرياضية والمنطقية الصارمة مثل WeMath وMathVista.

في جميع المهام، حققت Metis أداءً متطورًا أو تنافسيًا للغاية، متفوقة على نماذج الوكلاء الحالية – بما في ذلك Skywork-R1V4 الأكبر بكثير والتي تبلغ 30 مليار معلمة – في كل من مهام الإدراك البصري والاستدلال.

بنفس القدر من الأهمية هو السلوك القصصي لميتس الموضح في التجارب. على سبيل المثال، نماذج الوكلاء القياسية، بعد رؤية صورة لافتة متحف والسؤال عما يقوله النص الأوسط، تضيع الوقت في كتابة نصوص بايثون بشكل أعمى لاقتصاص الصورة فقط لقراءتها. ومع ذلك، تدرك Metis أن النص واضح ومقروء في الصورة الأولية. فهو يتجاوز الأدوات تمامًا ويستخدم تمريرة استدلال واحدة.

في تجربة أخرى، تم إعطاء النموذج رسمًا بيانيًا مركبًا وطُلب منه تحديد ثاني أكبر خط عند نقطة بيانات محددة في مخطط فرعي صغير. وجد ميتيس أن التحليل البصري الدقيق تجاوز قدرات الدقة الأصلية ولم يتمكن من التمييز بدقة بين الخطوط المتداخلة. بدلًا من التخمين من الصورة الكاملة، استخدم لغة بايثون لقص وتكبير تلك المنطقة المعينة فقط من الحبكة الفرعية، مما يسمح لها بتحديد الخطوط بشكل صحيح. فهو يتعامل مع الكود كأداة دقيقة تستخدم فقط عندما تكون الأدلة المرئية غامضة حقًا، وليس كبديل احتياطي.

لقد أطلق العلماء مستيزو جنبا إلى جنب مع كود HDPO بموجب ترخيص Apache 2.0 الليبرالي.

وخلص الباحثون إلى أن “نتائجنا تظهر أن استخدام الأدوات الاستراتيجية والتفكير الجيد ليسا مقايضة؛ بل إن التخلص من استدعاءات الأدوات الصاخبة والمتكررة يساهم بشكل مباشر في الدقة الفائقة”. “على نطاق أوسع، يشير عملنا إلى تحول نموذجي في التعلم المعزز بالأدوات: من مجرد تدريس النماذج كيفية استخدام الأدوات إلى تنمية الحكمة ما وراء المعرفية حول متى يجب الامتناع عن استخدامها”.